Hallo Ralf,

ich habe mich auf die Zukunft des autonomen Fahrens bezogen und nicht auf die aktuellen Assistenzsysteme. Da ist zwischen Tesla und den anderen Hersteller wahrscheinlich kein großer Unterschied.

Mir ging es ganz generell um das zukünftiges GUI für autonomes Fahren. Da ist meiner Meinung nach das gezeigte Beispiel im Bosch Film doch recht künstlich und sehr auf den aktuellen Tesla mit seinem goßen Bildschirm als Hauptinformationsanzeige bezogen.

Ich halte alle Dinge die den Blick von der Straße lenken für potentiell sehr gefährlich. Sie verlängern die Reakionszeit beträchtlich. Wir entwickeln und betreiben seit mehr als 20 Jahren eine Vielzahl von Fahrsimulatoren wo tagtäglich mit hohem technischen und wissenschaftlichen Aufwand Untersuchungen zum HMI im Auto durchgeführt werden. Die Ergebnisse die die Automobilhersteller daraus gezogen haben sieht man an den über die Jahre gemachten Veränderungen, z.B. bei der Navigation.

Der Bildschirm ist zuerst vom ehemaligen Autoradioschacht nach oben neben die Instrumente gewandert, damit es ausreicht alleine die Augen zu bewegen. Im oberen Bereich ist man bei Tesla nahe dran, aber wenn der ganze Bildschirm für die Anzeige genutzt wird dann bleibt es nicht aus , dass man manchmal den ganzen Kopf bewegen muss um die gewünschte Information auf dem großen Bildschirm zu finden.

Dann ist die Navigationsinformation teilweise in das Instrumentencluster gewandert, z.B. bei Anweisungen zum Abbiegen. Weil man gerade in diesem Augenblick die höchste Aufmerksamkeit auf der Straße haben sollte. Tesla macht das ja auch.

Der nächst Schritt war dann das HUD, welches den Blick auf der Straße hält. Da ist Tesla derzeit nicht auf dem Stand der Technik anderer Luxuslimosinen.

Man hat festgestellt, dass das immer noch nicht perfekt ist, da es den Leuten schwer fällt Abbiegeanweisungen der realen Sicht zuzuordnen. Deshalb ist der nächste Schritt kontakt-analoge Information/Augmented Reality nur logisch. D.h, die Anweisungen werden so angezeigt, dass sie der Fahrer wie auf die Straße gepinselt sieht. Das wird aktuell mit HUD Technologie realisiert. Die VR-Brille von BMW zeigt in welche Richtung das noch weiter gehen könnte. Ob das wirklich akzeptiert wird, wird sich zeigen.

Vor diesem Hintergrund, ist es mir unverständlich warum in dem Werbefilm wesentliche Anzeigen und Aktionen auf dem ergnomisch äußerst ungünstig platzierten Bildschirm in der Mittelkonsole erfolgen. Dies kann doch nicht die Zukunft sein. Ich hätte erwartet, dass die wesentlichen Aktionen zumindest über das Instrumentencluster angezeigt und Tasten am Lenkrad gesteuert werden.

Ich gehe deshalb davon aus, dass das was in dem Infofilm gezeigt wird bei keinem Hersteller so auf die Straße kommt.

Was die Sensorik hinsichtlich Assistenzsystemen und autonomen Fahren betrifft geht die Entwicklung in Richtung 4 HD-Kameras ergänzt um kleine Lasersscanner und vorhandene Ultraschallsensoren. Der Radarsensor ist schon wieder etwas auf dem Rückzug, da man praktisch alles was man früher nur mit dem Radarsensor machen konnte (Abstandsmessung) mittlerweile schon mit einer einzelnen HD-Kamera machen kann. Die vier Kameras umfassen das komplette Umfeld des Fahrzeugs und erzeugen über Fusion ein komplettes Umfeldmodell mit Tracking jedes Gegenstands.

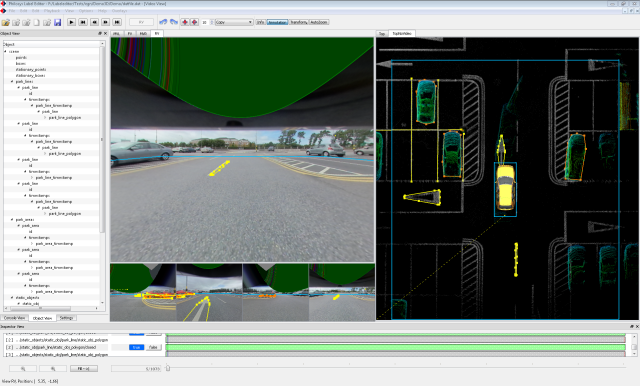

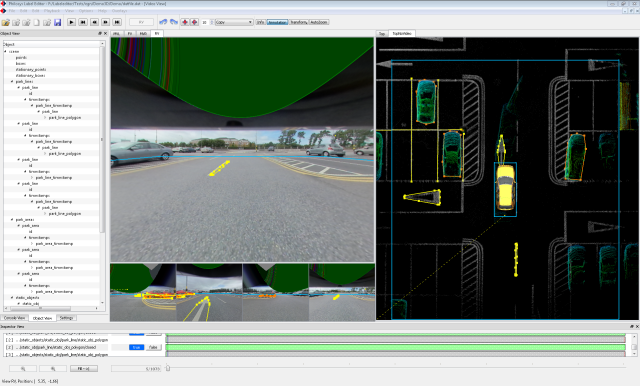

Hier ist mal ein Beispiel für eine solche Szene von unserer Webseite:

Mit nur einer nach vorne gerichteten Kamera ist Tesla hier im Hintertreffen. Es ist deshalb davon auszugehen, dass zukünftige Fahrzeuge mehr Kameras bekommen werden.

ich habe mich auf die Zukunft des autonomen Fahrens bezogen und nicht auf die aktuellen Assistenzsysteme. Da ist zwischen Tesla und den anderen Hersteller wahrscheinlich kein großer Unterschied.

Mir ging es ganz generell um das zukünftiges GUI für autonomes Fahren. Da ist meiner Meinung nach das gezeigte Beispiel im Bosch Film doch recht künstlich und sehr auf den aktuellen Tesla mit seinem goßen Bildschirm als Hauptinformationsanzeige bezogen.

Ich halte alle Dinge die den Blick von der Straße lenken für potentiell sehr gefährlich. Sie verlängern die Reakionszeit beträchtlich. Wir entwickeln und betreiben seit mehr als 20 Jahren eine Vielzahl von Fahrsimulatoren wo tagtäglich mit hohem technischen und wissenschaftlichen Aufwand Untersuchungen zum HMI im Auto durchgeführt werden. Die Ergebnisse die die Automobilhersteller daraus gezogen haben sieht man an den über die Jahre gemachten Veränderungen, z.B. bei der Navigation.

Der Bildschirm ist zuerst vom ehemaligen Autoradioschacht nach oben neben die Instrumente gewandert, damit es ausreicht alleine die Augen zu bewegen. Im oberen Bereich ist man bei Tesla nahe dran, aber wenn der ganze Bildschirm für die Anzeige genutzt wird dann bleibt es nicht aus , dass man manchmal den ganzen Kopf bewegen muss um die gewünschte Information auf dem großen Bildschirm zu finden.

Dann ist die Navigationsinformation teilweise in das Instrumentencluster gewandert, z.B. bei Anweisungen zum Abbiegen. Weil man gerade in diesem Augenblick die höchste Aufmerksamkeit auf der Straße haben sollte. Tesla macht das ja auch.

Der nächst Schritt war dann das HUD, welches den Blick auf der Straße hält. Da ist Tesla derzeit nicht auf dem Stand der Technik anderer Luxuslimosinen.

Man hat festgestellt, dass das immer noch nicht perfekt ist, da es den Leuten schwer fällt Abbiegeanweisungen der realen Sicht zuzuordnen. Deshalb ist der nächste Schritt kontakt-analoge Information/Augmented Reality nur logisch. D.h, die Anweisungen werden so angezeigt, dass sie der Fahrer wie auf die Straße gepinselt sieht. Das wird aktuell mit HUD Technologie realisiert. Die VR-Brille von BMW zeigt in welche Richtung das noch weiter gehen könnte. Ob das wirklich akzeptiert wird, wird sich zeigen.

Vor diesem Hintergrund, ist es mir unverständlich warum in dem Werbefilm wesentliche Anzeigen und Aktionen auf dem ergnomisch äußerst ungünstig platzierten Bildschirm in der Mittelkonsole erfolgen. Dies kann doch nicht die Zukunft sein. Ich hätte erwartet, dass die wesentlichen Aktionen zumindest über das Instrumentencluster angezeigt und Tasten am Lenkrad gesteuert werden.

Ich gehe deshalb davon aus, dass das was in dem Infofilm gezeigt wird bei keinem Hersteller so auf die Straße kommt.

Was die Sensorik hinsichtlich Assistenzsystemen und autonomen Fahren betrifft geht die Entwicklung in Richtung 4 HD-Kameras ergänzt um kleine Lasersscanner und vorhandene Ultraschallsensoren. Der Radarsensor ist schon wieder etwas auf dem Rückzug, da man praktisch alles was man früher nur mit dem Radarsensor machen konnte (Abstandsmessung) mittlerweile schon mit einer einzelnen HD-Kamera machen kann. Die vier Kameras umfassen das komplette Umfeld des Fahrzeugs und erzeugen über Fusion ein komplettes Umfeldmodell mit Tracking jedes Gegenstands.

Hier ist mal ein Beispiel für eine solche Szene von unserer Webseite:

Mit nur einer nach vorne gerichteten Kamera ist Tesla hier im Hintertreffen. Es ist deshalb davon auszugehen, dass zukünftige Fahrzeuge mehr Kameras bekommen werden.